Algoritmos contra insultos: así se mide el odio en internet

zentauroepp46056315 mas periodico tema odio foto twitter181130153613 / periodico

Juan Fernández

Periodista

Juan Fernández

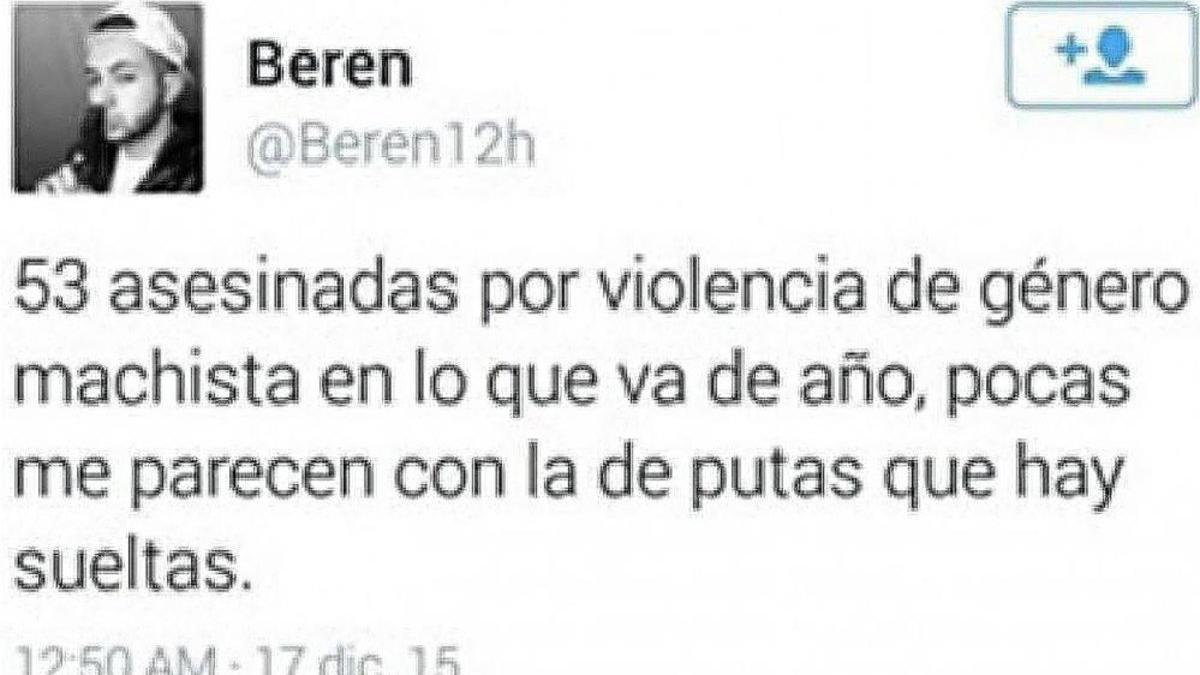

Un mismo insulto racista publicado en las redes sociales acarrea una pena mayor (entre dos y cuatro años de cárcel) que si se pronuncia en plena calle (entre uno y cuatro años). Este matiz, recogido por el Código Penal, evidencia la amenaza que entraña ahora mismo la red como canal preferente de propagación de mensajes que van nutriendo la llamada cultura del odio. Las plataformas son, según todos los expertos, el principal campo de batalla en la lucha contra los discursos de odio por su capacidad casi inabarcable para difundir todo tipo de mensajes tóxicos y lo difícil que resulta controlarlos.

Cada día, de media, se escriben en la red unos 10.000 mensajes tóxicos

Descartada –por imposible– la opción de ponerle puertas al campo –en este caso a la red–, la Policía se plantea un reto menor, aunque también ambicioso: tenerlo vigilado. El Ministerio del Interior va a empezar a utilizar una aplicación digital que le permitirá monitorizar en tiempo real el clima de odio que se respira en la red. «No sirve para identificar casos concretos, que de eso ya se encargan otros equipos de la Policía, sino para conocer hacia dónde se dirigen mayoritariamente los insultos, de dónde provienen las amenazas y cuál es el nivel de crispación que hay en la red», explica Miguel Camacho, jefe de la Oficina Nacional Lucha contra Delitos de Odio del Ministerio del Interior, inspector de policía de profesión y matemático de formación.

Interpretar el contexto

El programa es una adaptación del trabajo fin de máster del ingeniero informático Juan Carlos Pereira Kohatsu, de la Universidad Autónoma de Madrid, quien se propuso crear un algoritmo que discriminara, entre la masa de mensajes que se escriben en la red, los que son agresivos, ofensivos y amenazantes contra colectivos concretos o personas particulares. La gracia del invento radica en que el algoritmo no se limita a identificar las palabras que suelen aparecer en este tipo de tuits –normalmente, insultos o descalificaciones–, sino que sabe leer los mensajes y es capaz de interpretar el contexto, lo que permite afinar en la identificación de los contenidos de odio. Incluso procesa la información que aportan los emoticonos.

La aplicación actúa sobre un volumen de seis millones de tuits cada 24 horas

La aplicación actúa sobre un volumen de 6 millones de tuits cada 24 horas, lo que supone una muestra bastante representativa de la atmósfera que se respira en Twitter en cada momento. Extrapolando los datos obtenidos a toda la plataforma, Pereira ha descubierto que cada día, de media, se escriben en la red unos 10.000 mensajes tóxicos.

Los palos, para los políticos

"Lo sorprendente es que la cifra no suele variar. Cambian los autores de los mensajes y los destinatarios, pero el nivel de odio de la red es constante", señala el ingeniero, quien ha probado la herramienta en días concretos extrayendo conclusiones llamativas. "La noche de Eurovisión, Alfred fue el destinatario de la mayoría de los ataques. Lo pusieron a caldo por ser catalán. En los Madrid-Barça, no falla: o se insulta por la política o se carga contra los futbolistas más destacados. Y los días normales, los políticos son los que suelen llevarse los palos", ilustra.

El 80% de los usuarios que reciben una advertencia de Twiiter se cuida de caer de nuevo en el error

La otra forma de actuar sobre el odio que circula por las redes tiene que ver con la concienciación de los propios usuarios, tarea en la que suelen estar concentradas las plataformas. Desde el 2017, Twitter ha introducido 50 cambios en las políticas de uso de su aplicación para mejorar la salud de la conversación digital. Las normas de la compañía prohíben taxativamente la promoción de la violencia, pero esto no impide que la red sea un continuo cruce de insultos.

Contra esto solo cabe un camino: bloquear al agresor y reportarlo a Twitter, quien, dependiendo de la gravedad de cada caso, advierte al atacante para que borre el mensaje tóxico, le suspende el perfil de forma temporal o se lo cancela permanentemente. El toque de atención suele funcionar: según fuentes de Twitter, el 80% de usuarios advertidos se cuida de caer de nuevo en el error. «Las cuentas reportadas por abuso solo constituyen el 1% de todo Twitter», aclara una portavoz de la compañía. El problema es que ese 1% provoca un ruido que contamina a toda la red.