INTELIGENCIA ARTIFICIAL

Científicos boicotean una universidad surcoreana que desarrolla 'robots asesinos'

50 investigadores de 30 países distintos advierten que la aplicación de inteligencia artificial al campo militar puede llevar "la tercera revolución de las guerras"

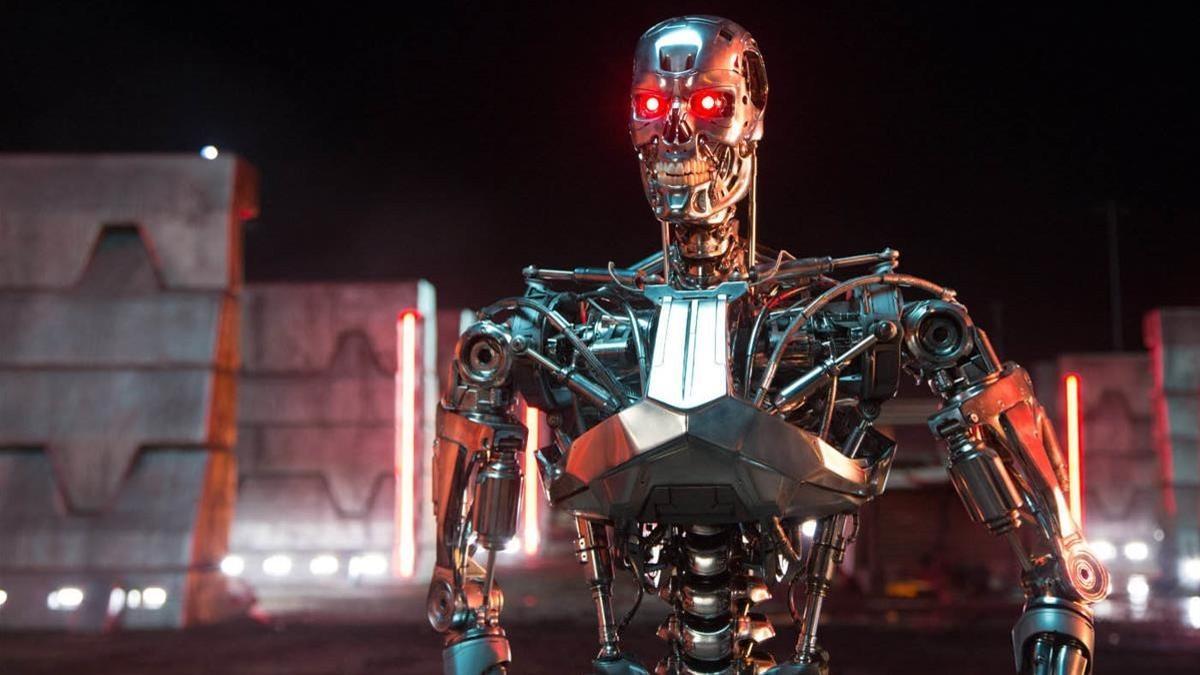

Imagen de la película Terminator Génesis, del 2015.

Más de 50 investigadores sobre inteligencia artificial, procedentes de 30 países distintos, han anunciado este miércoles un boicot contra el Instituto Avanzado de Ciencia y Tecnología (KAIST) de Corea del Sur, por la inauguración de un nuevo laboratorio, según denuncian los expertos, destinado al desarrollo de armas autónomas letales (LAWs por sus siglas en inglés), también conocidas como 'robots asesinos'.

En una carta abierta al presidente de la KAIST, los científicos firmantes han declarado que no colaborarán con la universidad surcoreana ni recibirán profesores invitados hasta que la institución se comprometa a detener el desarrollo de armas de inteligencia artificial que no necesiten de un "significativo control humano".

KAIST abrió en febrero su nuevo laboratorio, en colaboración con Hanwha Systems, una empresa especializada en sistemas de defensa y una de las principales productoras de bombas de racimo en Corea del Sur. En su inauguración, la universidad declaró que el objetivo del nuevo centro era el de desarrollar sistemas de comando y decisión basados en tecnología de inteligencia artificial, algoritmos de navegación para vehículos submarinos no tripulados y aeronaves con tecnología inteligente de seguimiento y reconocimiento de objetos.

Caja de Pandora

En la carta, los expertos advierten que el desarrollo de estos robots asesinos es una caja de Pandora que, una vez abierta, será difícil de cerrar y desembocará en la tercera gran revolución de las guerras. "Si se desarrollan, las armas autónomas permitirán que las contiendas se luchen de forma más rápida y una escala más grande que nunca" advierten los expertos.

El boicot ha sido organizado por Toby Walsh, profesor de la Universidad de New South Wales en Sídney, quien ha declarado a Reuters que la inteligencia artificial puede tener usos más positivos en el campo militar, como limpiar campos de minas, pero que desde luego, "no deberíamos cederle la decisión de quién muere y quién vive a una máquina, esto cruza una clara línea moral".

Falta de consenso internacional

La carta ha sido publicada en previsión de la reunión en Ginebra el próximo lunes del Grupo de Expertos Gubernamentales de la ONU sobre Sistemas de Armas Autónomas Letales, en la que se discutirá una posición oficial respecto a este tipo de armas.

En su carta abierta, los expertos reprochan a la KAIST que mientras que las Naciones Unidas intentan determinar cómo contener la amenaza de esta nueva tecnología, "es de lamentar que una universidad prestigiosa busque acelerar la carrera armamentística de inteligencia artificial", carrera que lideran Estados Unidos, China y Rusia.

Precisamente estos son los países abiertamente reacios a prohibir el desarrollo de estas armas. En contraposición, la coalición internacional Stop Killer Robots que lucha por la ilegalización de las LAWs , hizo público en noviembre un documento que que incluía a los 22 países a favor de la prohibición, en su mayoría países en vías de desarrollo.

- El de la Policía Nacional para los robos en las viviendas: "Si los ves, no toques nada

- Comprobar si mi número de La Grossa de Sant Jordi 2024 tiene premio

- Sorteo de la Grossa de Sant Jordi 2024, en directo: números premiados y comprobar

- El mundo de la cultura, de Almodóvar a Serrat, convoca una concentración para pedir un alto el fuego en Gaza

- RTVE elimina el último programa de Masterchef en el que se denigró a una concursante que abandonó por estrés

- Lleida acumula en pocas horas la lluvia caída en más de dos años

- Alerta de la Policía Nacional sobre una estafa que puede afecta a miles de personas

- Adiós a los cajones de la cocina: la solución con perchas que puedes colocar en cualquier parte