Manipulación de la realidad

Porno no consentido, la gran amenaza de los 'deepfakes'

Crece el uso de vídeos manipulados, cada vez más accesibles y sofisticados, para falsa pornografía que castiga doblemente a las mujeres

Su reciente aparición hace que las autoridades aún no cuenten con protocolos para combatir el mal uso de esta tecnología

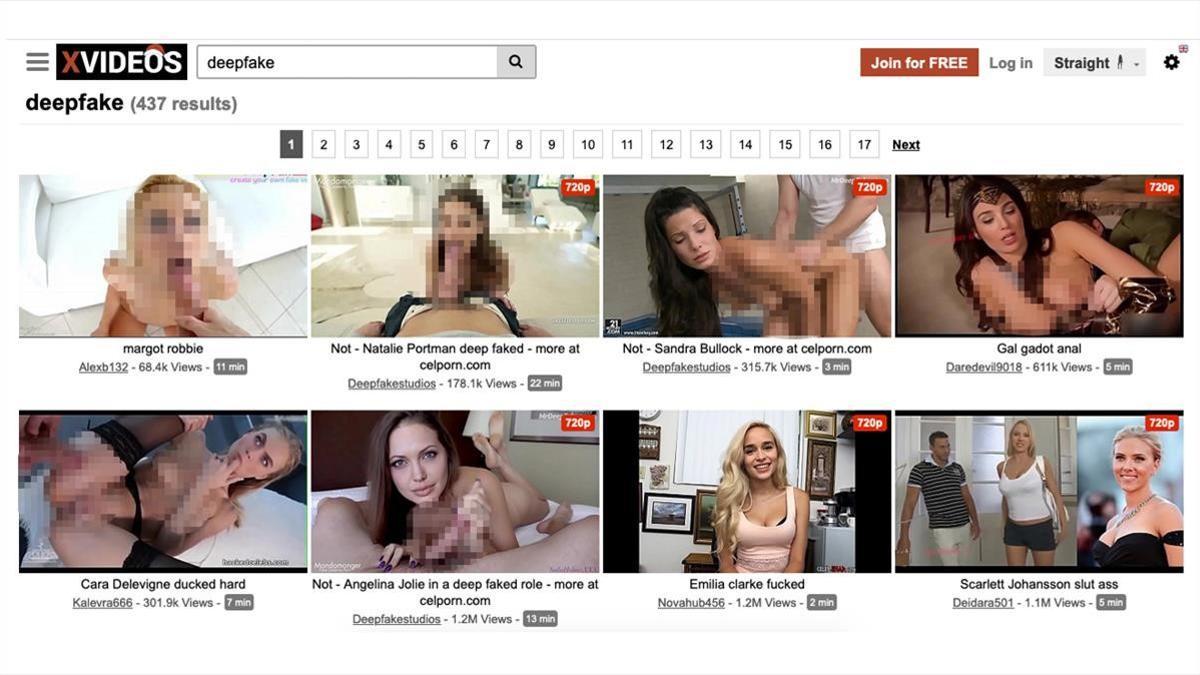

Resultados de videos deepfake de famosas en el portal pornografico Xvideos

Carles Planas Bou

Periodista

Periodista tecnológico entre el mundo digital y la política internacional. Centrado en capitalismo de plataformas, IA, vigilancia y derechos digitales. Excorresponsal en Berlín durante más de cuatro años, cubrió los gobiernos de Merkel, la crisis de los refugiados y el auge de la extrema derecha. También ha trabajado en Europa Central y en Canadá. Graduado en Periodismo por la URL y máster en Relaciones Internacionales por la UAB. Ha colaborado con TV3, TVE, Deutsche Welle, Catalunya Ràdio, El Orden Mundial o El Salto.

La clase política española como si fuese el Equipo A, Hitler y Stalin cantando ‘Video Killed the Radio Star’ o Jennifer Lawrence recogiendo un premio con la cara de Steve Buscemi. Seguramente en los últimos meses te has reído con alguno de estos hipnóticos 'deepfakes'vídeos manipulados digitalmente que permiten retocar las imágenes para colocar la cara de una persona en el cuerpo de otra, creando realidades paralelas confusas.

Aunque se ha hablado mucho del potencial de esta tecnología para el engaño y la manipulación política, su principal amenaza es mucho más tangible: la pornografía sin consentimiento. Y es que, según un estudio del grupo de investigación Deeptrace, el 96% de los 'deepfakes' detectados recrean escenas de sexo. Sensity, una compañía de inteligencia ubicada en Ámsterdam, alerta de que este 2020 estos vídeos se han popularizado, colgándose hasta 1.000 por mes.

Los primeros 'deepfakes' aparecieron en 2017, pero mucho ha cambiado desde entonces. La tecnología de inteligencia artificial es cada vez más precisa y compleja y el número de aplicaciones que facilitan la creación de esos vídeos se ha disparado. En 2016, se requirió a todo un equipo de expertos para que la princesa Leia —la ya fallecida Carrie Fisher—pudiese aparecer en la película ‘Rogue One’. Ahora, el fenómeno se ha popularizado y su accesibilidad ha llevado a que usuarios con conocimientos básicos puedan utilizar la tecnología para realizar parodias, pero también para explotar falsas recreaciones pornográficas.

Así, aplicaciones como DeepNude (ya eliminada) solo necesitan una fotografía de sus víctimas —fácilmente extraíble de su perfil de Facebook u otras plataformas— para recrear vídeos pornográficos más o menos creíbles. Eso es lo que le ha sucedido a más de 680.000, víctimas de un 'bot' de un canal de Telegram que desnudaba las fotos que les mandaban otros usuarios. Según Sensity, antes de desarticularse la red contaba con 101.080 miembros, un 70% de los cuales residen en Rusia o el Este de Europa. En un 70% de los casos detectados, las fotos provenían de redes sociales o fuentes privadas.

Abuso contra las mujeres

Scarlett JohanssonGal GadotAngelina JolieAriana GrandeEl tamaño del problema es difícilmente medible. Sensity trata de llevar la cuenta: en julio de 2019 habían detectado 14.678 vídeos, este junio 49.081 y a fecha de la publicación de este reportaje la cifra ya llega a los 82.266. Hasta 3.398 personajes públicos se han visto afectados por los 'deepfakes'.

Pero los expertos advierten de que esas turbias prácticas golpean cada vez más a todo tipo de mujeres, que ni sospechan de su presencia en estos rincones oscuros de internet. Y es que, más allá de satisfacer perversas fantasías sexuales, los 'deepfakes' de desnudos pueden servir para acosar o chantajear a sus víctimas, algo que puede traducirse en consecuencias que van de la humillación pública a pérdida del empleo o a la violencia de género. “Todo esto forma parte del acoso al que las mujeres tienen que enfrentarse en el entorno digital, ya sea a través de ‘troleo’ o del abuso sexualizado procedente de todos los rincones del espectro político”, explicaba la analista tecnológica Nina Jankowicz en declaraciones a ‘BuzzFeed’.

El gran impacto del porno

En febrero de 2018, el portal pornográfico Pornhub —cuyos vídeos se ven más de 100.000 millones de veces al año— aseguró que prohibiría la difusión de 'deepfakes'. Sin embargo, dos años y medio después aún era sencillo encontrar una ingente cantidad de esas manipulaciones circulando por la página, violando sus propias políticas. Al visualizarlo, además, el algoritmo de Pornhub recomendaba más 'deepfakes' con otras víctimas. A principios de diciembre, la página eliminó más de 13 millones de vídeos no consentidos de su plataforma tras destaparse que se había lucrado de la monetización de vídeos con violaciones o acoso a menores.

Algunos de estos canales sirven para redirigir al usuario a chats privados de Telegram, donde se venden vídeos personalizados o se dan tutoriales pagados para aprender a realizar esas manipulaciones. El fenómeno se repite en otras webs pornográficas como XVideos, xHamster o Mr. Deepfakes, donde las visualizaciones se cuentan por millones. En la última incluso se insta a los usuarios a compartir sus “creaciones”. Esas páginas no son residuales. XVideos y Pornhub están entre las 10 webs más visitadas del mundo, más que Amazon, Netflix o Zoom.

Consecuencias legales

España privacidad Vanessa AlarcónSergio Carrasco MayansAsí, los vídeos manipulados con la intención de realizar parodias pueden recaer bajo el paraguas de la libertad de expresión, mientras que aquellos que atentan contra el honor y la propia imagen, como los pornográficos, pueden suponer un delito de injurias, difamación o calumnias y acarrear multas, indemnizaciones e incluso condenas. “Se te condena si eres falaz, si quieres engañar a la gente con esa manipulación”, explica el abogado Borja Adsuara.

La novedad de esta tecnología y los abusos que se cometen con ella hace que aún no haya respuestas claras. Consultados por este diario, los Mossos d'Esquadra confirman que no tienen un protocolo que contemple los riesgos de los 'deepfakes' ni sus prevenciones. “A medida que vayan apareciendo nuevos casos, algo que desgraciadamente sucederá, se irán estableciendo nuevos protocolos”, señala Carrasco. Adsuara alerta de que esos métodos para manipular la realidad se extiendan a otros ámbitos como en la falsificación de pruebas. “Aún no ha estallado, pero lo hará”.

Suscríbete para seguir leyendo

- La persona más mayor del mundo, la catalana Maria Branyas, se convierte en la octava más longeva de la historia

- Crisis en una escuela compleja de Badalona: pierde a 20 profesores de un plumazo tras el proceso de estabilización docente

- Puente de cuatro días a la vista en Barcelona: esta es la fecha

- Un brote de salmonelosis en un bar de Barcelona deja al menos 22 afectados tras comer tortilla de patatas

- Incautadas cuatro toneladas de cocaína escondidas entre sacos de arroz en el puerto de Barcelona

- La Policía Nacional advierte del “smishing”, la nueva forma de estafarte a través del móvil

- Víctor Dieste, profesor en el barrio de Sant Roc: 'Tenemos alumnado que no tiene informe de notas porque no viene lo suficiente

- Un episodio de calor extremo y polvo sahariano inundará Catalunya la semana que viene