Se puede llegar a ver con las manos

Se puede llegar a ver con las manos

Una nueva tecnología desarrollada en el Instituto Weizmann de Ciencias, en Israel, convierte la información visual en señales táctiles, lo que permite «ver» objetos distantes mediante las manos. El usuario percibe la información a través de la exploración activa del entorno, sin la confusa intervención de ayudas de estimulación artificial.

Según una nota de prensa, el nuevo sistema identifica objetos correctamente en menos de 20 segundos, un nivel de rendimiento sin precedentes en comparación con los métodos de visión al tacto existentes. La investigación que fue la base para la creación de la nueva tecnología se publicó en la revista iScience.

Los resultados de esta innovación se sustentan en la apuesta por una exploración dinámica y siempre activa del entorno. Como las personas que la utilizan pueden experimentar sensaciones en forma directa mediante sus manos, se produce una interacción más sencilla que facilita el uso y hace posible que el dispositivo logre un mejor desempeño con relación a otros sistemas similares.

Al tratarse de una solución intuitiva, que no emplea incómodas interfaces que alejan al usuario de las sensaciones reales, la tecnología ha logrado idénticos resultados positivos en las pruebas con personas videntes y no videntes.

En consecuencia, se vuelve atractiva tanto para quienes adquieren una herramienta para «descubrir» el mundo ante la imposibilidad de verlo, en el caso de los invidentes, como para aquellos usuarios que pueden usar el movimiento de sus manos casi como un nuevo sentido.

Exploración activa e intuitiva

El sistema requiere indefectiblemente la detección activa: no hay estimulaciones artificiales de por medio. Al estar obligado a usar sus manos, el objeto a detectar a distancia es «tocado» y «visto» al mismo tiempo por el usuario, que escanea el entorno para conseguir el objetivo buscado.

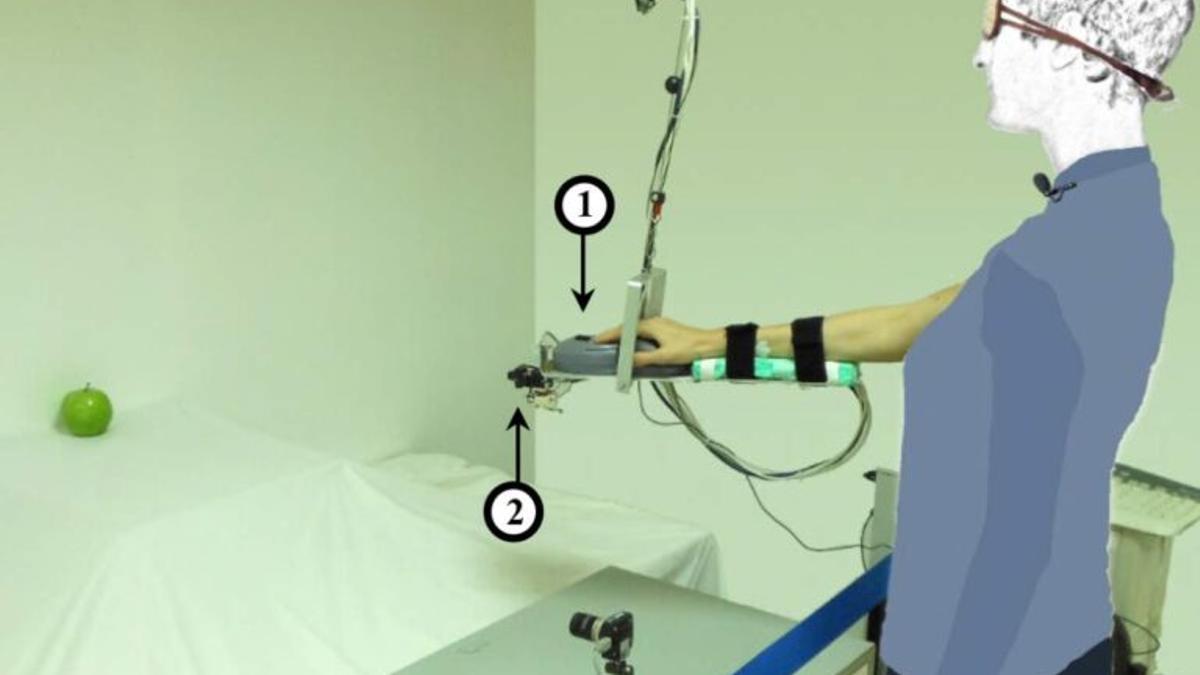

La tecnología ha sido denominada ASenSub, e incluye una pequeña cámara liviana que se coloca sobre la mano del usuario. Las imágenes que captura durante las exploraciones del entorno se transforman en señales táctiles mediante una matriz, distribuida sobre la superficie inferior de tres dedos de la misma mano que gestiona la cámara.

Aunque las sensaciones sean virtuales, adquieren un realismo no visto en tecnologías previas. Por ejemplo, si se escanea un triángulo con el dispositivo la sensación no se corresponde con una figura plana, como si se tratara de un gráfico. Por el contrario, se recepciona un triángulo con su relieve correspondiente y con todos los detalles que presente el objeto.

La plasticidad del cerebro humano

El concepto que subyace a esta aplicación tecnológica es la denominada sustitución sensorial, a través de la cual se obtiene información con un sentido a través de las señales que han podido percibirse con otro. La exploración de esta clase de tecnologías amplía la comprensión sobre los mecanismos de la percepción humana

Al mismo tiempo, puede convertirse en una herramienta de gran utilidad para mejorar la calidad de vida de las personas ciegas o con problemas visuales graves. Sin embargo, no hay antecedentes sobre otras aplicaciones de este tipo que hayan podido incorporarse a la cotidianeidad de los invidentes, mayormente porque no presentan el carácter intuitivo y dinámico que se requiere. Este nuevo desarrollo podría inaugurar una nueva tendencia al respecto.

Los investigadores han resaltado que esta nueva tecnología no solamente puede ser muy útil para las personas con discapacidades visuales, sino que además sirve para comprobar la enorme plasticidad del cerebro humano: al explorar el entorno de una forma activa, el cerebro es capaz de «inventar» un nuevo sentido en pocos segundos, demostrando una vez más que sus posibilidades son prácticamente infinitas.

Referencia

Active sensory substitution allows fast learning via effective motor-sensory strategies. Yael Zilbershtain-Kra, Shmuel Graffi, Ehud Ahissar and Amos Arieli. iScience (2021).DOI:https://doi.org/10.1016/j.isci.2020.101918

Foto: en el nuevo sistema, un dispositivo especial (1) crea señales táctiles sobre la base de la información visual capturada por una pequeña cámara (2). Crédito: Weizmann Institute of Science / Yael Zilbershtain-Kra et al / iScience.

- Adiós a este mítico presentador de TV3

- Corte de la Línea 2 del metro de Barcelona durante 26 horas: los trenes no circularán entre estas estaciones

- Carlos, una persona trans, denuncia a su mujer por malos tratos y la jueza le da a ella la custodia de su hijo

- Olvídate de freír el huevo en la sartén: esta es la fórmula para hacer los mejores huevos fritos

- La policía colombiana detiene a uno de los sospechosos de matar al asesino de la Vila Olímpica

- Así engañaron a la hija los asesinos de una familia de Chiloeches: "Vaya chaletaco, estaréis forrados...

- Buenas noticias para los mayores de 65 años: esta es la ayuda que recibirán de Hacienda a partir de mayo

- Adiós Nissan, bienvenido Mister Chery